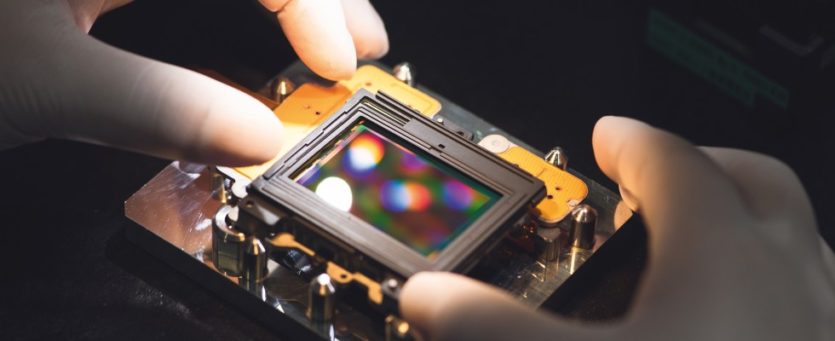

Der eigentliche Bildsensor wird von einem Deckglas geschützt. Dieses Foto stammt aus der Sensormontage in der Nikon-Fabrik im japanischen Sendai.

Foto: © Nikon

Es häufen sich Berichte über Fälle, in denen Kamerasensoren unter anderem durch Sonnen- oder Laserlicht irreparabel beschädigt wurden. Wir erklären, wie groß die Gefahr für die zentrale und oft kostspieligste Komponente unserer Kameras wirklich ist und was Fotografen tun können, um den Sensor zu schützen.

Die gute Nachricht ist, dass Bildsensoren tatsächlich robuster sind, als man gemeinhin denkt. Im Gegensatz zu den fragilen Verschlusslamellen beispielsweise bilden die Schichten, aus denen die Sensorbaugruppe besteht, eine sehr stabile Einheit. Die oberste Schicht ist ein vergütetes, sehr hartes Deckglas, das die darunter liegenden Filter, die Mikrolinsen und den CMOS-Chip selbst, vor mechanischen Schäden schützt. Daher könnte sich auch jeder Fotograf zutrauen, den Sensor selbst zu reinigen, wenn die Selbstreinigung des Sensors durch Ultraschallschwingungen beim Ein- und Ausschalten einmal nicht ausreicht.

Eine Nassreinigung mit einem frischen Swab oder das Abstempeln des Deckglases mit einem Gummistempel sind sichere Verfahren, bei denen der Anwender kaum etwas falsch machen kann. Wer sich dabei dennoch unwohl fühlt, kann die Sensorreinigung Fachleuten überlassen.

Sichtbares und unsichtbares Licht können den Sensor stark beschädigen.

Foto: © Getty Images / geogif

Schleichende Veränderungen

Die Gefahr der mechanischen Beschädigungen ist also gering, es bleiben aber andere, viel tückischere Gefahren: das Licht – und darüber hinaus viele andere Arten von Strahlung. Einfallendes Licht zu registrieren ist ja die Aufgabe des Sensors, weshalb es sich nicht einfach aussperren lässt, aber wenn die Lichtstärke ein gewisses Maß überschreitet, wird der Sensor nicht bloß überbelichtet, sondern kann dauerhaften Schaden nehmen.

Der Sensor ist zwar nicht als typisches Verschleißteil anzusehen, aber die Bildqualität kann dennoch im Laufe der Jahre langsam abnehmen. Einerseits durch den Ausfall einzelner Pixel, die durch starke kosmische Strahlung beschleunigt wird. Diese „Strahlen“ – genau genommen handelt es sich um einen Teilchenstrom – sind um so stärker, je weiter man sich von der Erdoberfläche entfernt, weshalb längere Flüge die Gefahr vergrößern. Ein wirkliches Problem ist das aber höchstens für Vielflieger – und für Piloten und Flugbegleiter, die im Dienst eine Kamera dabei haben. Allerdings werden die Einsatzzeiten des fliegenden Personals ohnehin kontrolliert, weil die kosmische Strahlung auch die Zellen des menschlichen Körpers schädigen kann.

Insbesondere UV-Licht kann die Farben der RGB-Filter im Sensorstapel ausbleichen, aber da über diesen Filtern noch ein UV/IR-Sperrfilter sitzt, bleibt dieser Effekt über die übliche Nutzungszeit einer Kamera generell unbemerkt. Wer sicher gehen will, kalibriert die Kamera regelmäßig mit einem ColorChecker-Target und einer Software wie Adobes kostenlosem DNG Profile Editor, um etwaige, schleichende Veränderungen der Farbwiedergabe auszugleichen.

Schutzlos ohne Spiegel?

Während normale Lichtstärken nur dann dauerhafte Schäden verursachen, wenn sie über eine lange Zeit einwirken, kann man den Sensor schon in Sekundenbruchteilen zerstören, wenn das Licht extrem hell ist – direktes, gebündeltes Sonnenlicht beispielsweise, aber auch Blitz- und Laserlicht. Diese Gefahrenquellen sind seit Jahren bekannt und im Internet finden sich viele anschauliche Filme, die konkrete Fälle illustrieren, etwa die Zerstörung eines CCDs mit einem Blitzgerät vor dem Objektiv aus dem Jahre 2010 (https://tinyurl.com/yyuylffu) oder den Ausfall einer Zeile eines CMOS-Sensors durch den Laser einer Lightshow (https://tinyurl.com/y3yd6rq5) von 2014.

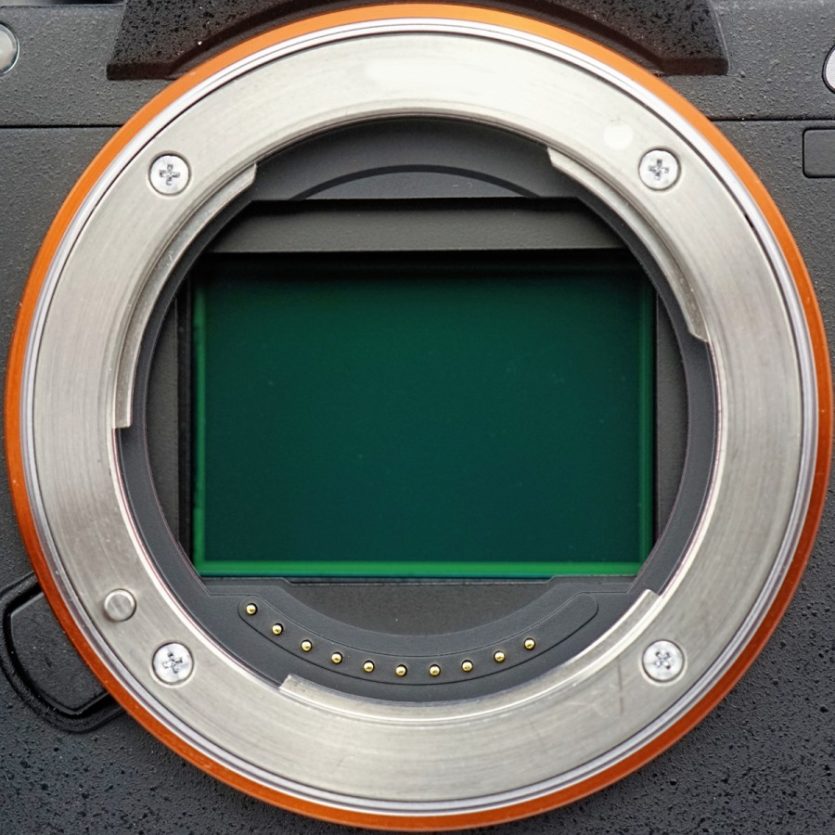

Wenn sich solche Fälle aber in den letzten Jahren zu häufen scheinen, so liegt das am immer größeren Marktanteil spiegelloser Kameras. Der Sensor einer DSLR ist ja nur während der meist nur Sekundenbruchteile andauernden Belichtung dem Licht ausgesetzt; davor und danach lenkt der Rückschwingspiegel das Licht auf die Einstellscheibe, sodass das Auge des Fotografen in viel größerer Gefahr als der Sensor schwebt. Diese Gefahr ist ganz real, etwa wenn Sie mit einer langen Brennweite einem Vogel oder Flugzeug folgen und das Motiv in Richtung der Position der Sonne am Himmel fliegt.

Bei den meisten spiegellosen Kameras ist der Sensor dagegen fast immer dem Licht ausgesetzt, denn der Schlitzverschluss schließt sich nur jeweils kurz vor und nach der Belichtung. Selbst wenn man die Kamera ausschaltet und ablegt, ohne sie mit einem Objektivdeckel zu schützen, kann einfallendes Licht Schaden anrichten – insbesondere dann, wenn das Objektiv auf Unendlich fokussiert ist und das parallel einfallende Licht der Sonne oder von Lasern in einem sehr kleinen Punkt gebündelt wird.

Glücklicherweise wird die Kamera meist stehen oder liegen, und da die Sonne in unseren Breiten auch mittags nicht sehr hoch steht und das Licht der tief stehenden, auf- oder untergehenden Sonne zu schwach ist, um eine Gefahr darzustellen, bleibt die Zahl der Schadensfälle gering. Dennoch sollten Besitzer spiegelloser Kameras dem Objektivdeckel mehr Aufmerksamkeit schenken und ihn immer dann aufsetzen, wenn die Kamera nicht in Gebrauch ist.

Unsichtbare Gefahren

Die Gefahren durch das Sonnenlicht können wir recht gut abschätzen. Wir sehen, wo die Sonne am Himmel steht, und können beurteilen, wie energiereich ihre Strahlen sind. Ob die Laser-Lightshows in Clubs oder bei Konzerten auch in den Bereich strahlen, in dem Sie mit Ihrer Kamera stehen, erkennen Sie ebenfalls recht schnell. Generell gilt, dass wir eine Lichtquelle, die uns zu hell erscheint, um direkt hinein zu schauen, auch unserer Kamera nicht zumuten sollten. Wie vorsichtig man sein muss, unterstreicht ein Video einer Tattoo-Entfernung mit Laserlicht: https://tinyurl.com/y4x35b7j. Das von der Haut reflektierte Licht eines Laserpulses reichte bereits aus, die davon getroffenen Pixel des Sensors einer Sony Alpha 7S II zu zerstören, denn der Fotograf hatte zwar mit einer Schutzbrille seine Augen, nicht aber das Objektiv der Kamera geschützt.

Die größte Gefahr droht allerdings von Infrarot-Lasern, deren Licht wir nicht wahrnehmen, die Sensoren unserer Kameras aber sehr wohl. Aktuell sind wir noch kaum mit starken IR-Lasern konfrontiert, denn für gängige Einsatzgebiete wie die Entfernungsmessung werden relativ leistungsschwache Laser genutzt. Das kann sich künftig ändern, wenn autonome Autos auf unseren Straßen unterwegs sein sollten.

Anfang 2019 machte ein Fotograf Bilder eines solchen Fahrzeugs auf der Unterhaltungselektronikmesse CES. Alle weiteren Aufnahmen mit seiner Sony Alpha 7R II zierten danach horizontale und vertikale Linien, die auf eine irreparable Beschädigung des Sensors hindeuteten. Die ersten Artefakte erschienen auf den Fotos des autonomen Autos und sie lagen auf der Höhe der Lidar-Kuppel auf dessen Dach. Der Verdacht lag nahe, dass das Lidar (Licht-Radar) der Firma AEye für den Schaden verantwortlich war.

Lidar in autonomen Autos

Die Funktionsweise des Lidars entspricht der des Radar, nur dass man statt Radiowellen die kürzeren Wellenlängen des infraroten Lichts verwendet. Aus der Zeit, die das vom Ziel reflektierte Laserlicht braucht, bis es seinen Ausgangspunkt wieder erreicht, lässt sich die Entfernung berechnen. So arbeiten auch Laser-Entfernungsmesser, aber mittlerweile gibt es Time-of-Flight-Sensoren, die mit jedem einzelnen Sensorpixel die Laufzeit des Lichts messen und damit eine Art Tiefen-Bild erzeugen können. Diese werden immer preiswerter. Für autonome Fahrzeuge ist Lidar eine Schlüsseltechnologie, denn gewöhnliche Kameras liefern nicht genug Daten, damit sich eine künstliche Intelligenz auf deren Basis sicher durch den Straßenverkehr bewegen könnte.

Auf der Elektronikmesse CES in Las Vegas fotografierte Jit Ray Chowdhury Anfang des Jahres ein autonomes Auto, das mit einem Lidar-System von AEye ausgestattet war. Auf den nachfolgenden Aufnahmen zeigten sich störende Linien, die auf einen beschädigten Sensor hindeuten.

Foto: © Jit Ray Chowdh

Wenn ein autonomes Fahrzeug Laserstrahlen in alle Richtungen schießt, um seine Umwelt abzutasten, dürfen diese natürlich nicht die Gesundheit von Passanten gefährden. Lidar-Laser arbeiten im Bereich des nahen Infrarot, also nahe den Wellenlängen des sichtbaren Lichts.

Oft werden Wellenlängen ab 850 nm genutzt, die unseren Augen gefährlich werden können, zumal das für uns unsichtbare Infrarot keinen Lidschlussreflex auslöst. Solche Laser dürfen daher nur eine sehr geringe Leistung abgeben. Laser mit einer längeren Wellenlänge von 1550 nm sind teurer, aber auch sicherer, denn ihr Licht wird weitgehend von der Hornhaut und der Linse des Auges absorbiert und kann die Netzhaut nicht schädigen.

Diese Wellenlänge lässt daher auch höhere Leistungen zu, aber sicher sind die Laser nur für unsere Augen – Kamerasensoren können durchaus Schaden nehmen. Das betrifft auch die autonomen Fahrzeuge selbst, die ja neben Lidar, Radar und Ultraschall vor allem auf Videokameras setzen, die Bilder im sichtbaren Spektrum aufnehmen. Falls die Straßen der Zukunft voller sich selbst steuernder Autos sein sollten, könnten deren Lidar-Systeme die Kameras anderer Fahrzeuge erblinden lassen.

Die Beschädigung des Alpha-7R II-Sensors ist in den Aufnahmen deutlich zu erkennen.

Foto: © Jit Ray Chowdhury

Für eine direkte Messung der Lichtlaufzeit werden kurze Pulse genutzt; aus der Zeit, die zwischen dem Laserpuls und der Rückkehr des reflektierten Lichts vergeht, ergibt sich die Entfernung. Kontinuierlich abgegebenes Licht wird dagegen moduliert: Der Laser moduliert das Licht beispielsweise mit einer Schwingung mit sich stetig ändernder Frequenz, und aus der Frequenz des abgegebenen und des empfangenen Signals lässt sich indirekt die Zeitdifferenz und daraus wiederum die Entfernung berechnen.

Solche kontinuierlich arbeitenden Laser können mit einer weit geringeren Leistung arbeiten und sind daher weniger gefährlich als die stärkeren und gepulsten Laser. Das System von AEye zeichnet sich dadurch aus, dass es die Umwelt mit einer hohen Bildrate abtastet und noch Fahrzeuge in 1000 Metern Entfernung erkennen soll. Dafür werden besonders starke, gepulste 1550-nm-Laser eingesetzt, sodass die davon ausgehende Gefahr für Kamerasensoren besonders hoch ist.

Kein Wunder also, wenn die Kamera eines Fotografen, der nur wenige Meter vom Lidar entfernt stand, dabei Schaden nahm. Da es sich im konkreten Fall um ein Versuchsmodell handelte, kann man aus solchen Vorfällen nicht auf drohende Gefahren in der Zukunft schließen, in der autonome Fahrzeuge zu unserem Alltag gehören. Im Autoverkehr auf Deutschlands Straßen wäre die Fähigkeit, einen Kilometer weit zu sehen, ohnehin wenig wert. Die Kamerahersteller tun dennoch gut daran, für eine Zeit zu planen, in der unsichtbare Laserstrahlen allgegenwärtig sind, und die Sensoren vor den gefährlichsten Wellenlängen zu schützen.

Schützt der Verschluss?

Wie erwähnt ist der Schlitzverschluss einer spiegellosen Kamera fast immer offen – selbst wenn die Kamera ausgeschaltet ist. Eine Ausnahme ist die Canon EOS R, deren Schlitzverschluss sich schließt, wenn der Fotograf das Objektiv wechselt. Fujifilm, Leica, Nikon, Olympus, Panasonic und Sony dagegen zeigen bisher keine Neigung, dem Vorbild Canons zu folgen und den Sensor durch den Verschluss abzudecken. Was spräche dagegen?

Tatsächlich ist ein Sensor robuster als die dünnen Metalllamellen eines Schlitzverschlussvorhangs. Letztere können sich leicht verbiegen, was zu Störungen beim gleichmäßigen Verschlussablauf führt – und über kurz oder lang auch zur Selbstzerstörung, wenn sich die Lamellen beim Öffnen oder Schließen ineinander verhaken. Auch an den Lamellen anhaftende Fremdkörper sind gefährlich, lassen sich aber nicht so problemlos entfernen wie vom Sensor.

Am sichersten sind die Verschlussvorhänge einer spiegellosen Kamera untergebracht, während der Verschluss geöffnet ist. Abgesehen davon, dass der schützende Rückschwingspiegel fehlt, ist der Abstand zwischen Sensor und Bajonett viel geringer als bei DSLRs. Vor dem Sensor muss noch der Verschluss Platz finden, der so nah am Bajonett um so leichter zu beschädigen wäre.

Auch die Vorstellung, ein geschlossener Verschluss könnte beim Objektivwechsel vor eindringendem Staub schützen, geht in die Irre. Schließlich ist Staub auf dem Sensor auch bei DSLRs ein Problem, obwohl deren Verschluss beim Objektivwechsel geschlossen bleibt und der Sensor hinter dem Rückschwingspiegel tief im Gehäuse liegt. Staub und andere Fremdkörper haben keinerlei Mühe, an einem geschlossenen Verschluss vorbei zum Sensor zu gelangen.

Dass sich in fast allen spiegellosen Kameras der Sensor allein den eindringenden Fremdkörpern entgegen stellt, ist durchaus sinnvoll, weil er dieser Aufgabe am besten gewachsen ist. Die empfindlichen Verschlusslamellen bleiben im Ruhezustand sicher verborgen.

Beitrage Teilen